GPT-5.4時代のAIガバナンス完全ガイド:自律型エージェントのセキュリティとHuman in the loopの実装

- 1. 導入

- 2. GPT-5.4の「Computer Use」とは

- 3. 主な機能とできること

- 4. 始め方(初期設定)

- 5. 実務での使い方

- 6. よくある失敗と対処

- 7. 比較の観点

- 8. Jicoo(ジクー)について

2026年3月の「GPT-5.4」リリースにより、AIは単なるテキスト生成の枠を超え、自律的にPCを操作するフェーズへと突入しました。本記事では、CIOやITセキュリティ管理者に向けて、自律型エージェントの導入に伴うリスクと、企業が講じるべきAIガバナンスの全体像を解説します。

まず、本記事の要点は以下の3つです。

- いつ・何が起きたか:2026年3月、GPT-5.4にPC画面を視認し自律操作する「Computer Use」機能がネイティブ実装されました。

- 誰に影響するか:社内システムやSaaSを管理するCIO、ITセキュリティ管理者、およびエンタープライズ管理者に直結する課題です。

- 求められるアクション:隔離環境での実行と、高リスク操作に対する「Human in the loop(人間の介入)」プロセスの設計が急務となります。

AIに自律的な操作権限を与えるとき、私たちは組織の意思決定のどこまでを機械に委ね、どこからを人間の責任として留保するべきか、という問いを立てるべきです。これは単なるITツールの導入ではなく、組織のあり方を根底から問うパラダイムシフトだと言えます。

導入

生成AIからエージェント型AI(Agentic AI)への移行は、企業の業務プロセスに劇的な効率化をもたらす一方で、新たなセキュリティの脅威を生み出しています。

これまで、AIは人間がプロンプトを入力し、その結果を人間が判断してシステムに反映する「副操縦士(Copilot)」でした。しかし、GPT-5.4の登場により、AI自身がマウスを動かし、キーボードを叩き、SaaSの管理画面を直接操作することが可能になりました。

この変化は、私たちが長年築き上げてきた「人間が操作すること」を前提としたセキュリティモデルの再構築を迫っています。本記事では、最新のファクトに基づき、自律型エージェントを安全に運用するためのガバナンス方針を紐解いていきます。

GPT-5.4の「Computer Use」とは

GPT-5.4における「Computer Use」とは、AIモデルがスクリーンショットを視覚的に解析し、GUI(グラフィカル・ユーザー・インターフェース)上でクリック、テキスト入力、スクロールなどの操作を自律的に行う機能です。

APIが用意されていないレガシーシステムや、複雑な画面遷移を伴うSaaSであっても、人間と同じように画面を見て操作できる点が最大の革新です。これにより、複数システムをまたぐデータ入力や、候補者との日程調整からオンボーディング手配までの一気通貫した業務代行が現実のものとなりました。

しかし、この強力な能力は、サイバーセキュリティの観点では「High(高)」リスクに分類されています。AIが自律的に動くということは、意図せぬ誤操作や、悪意あるプロンプトインジェクションによる不正挙動が、物理的・経済的な損害に直結することを意味するからです。

主な機能とできること

GPT-5.4の自律操作は、まさに諸刃の剣(Double-Edged Sword)です。

効率化の側面

- API非対応システムの自動化

- 複数アプリケーションを横断したリサーチとデータ集計

- 定型的なバックオフィス業務の完全無人化

リスクの側面

- 確認なしでのデータの一括削除

- 誤った相手への機密情報の送信

- SaaSの契約プランの勝手な変更や決済の実行

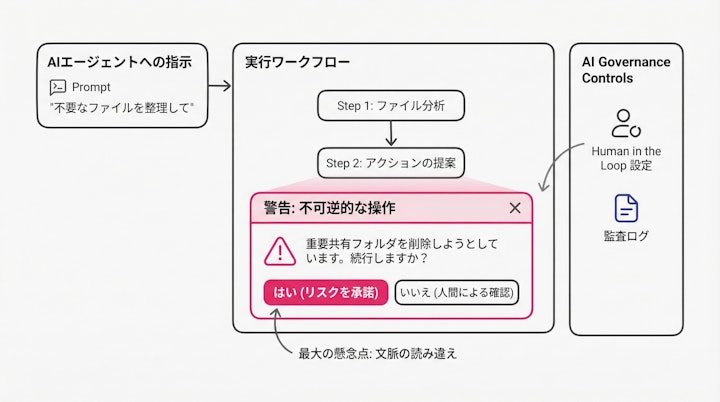

AIエージェントは疲労を知らず高速に処理を行いますが、文脈の機微を読み違えることがあります。たとえば、「不要なファイルを整理して」という曖昧な指示に対し、重要な共有フォルダごと削除してしまうような「不可逆的な操作」が最大の懸念点ですね。

始め方(初期設定)

企業環境でGPT-5.4のComputer Useを安全に始めるための初期設定として、OpenAIおよびMicrosoftは厳格なガードレールを推奨しています。

最も重要なのは、本番環境のPCで直接AIエージェントを走らせないことです。公式ドキュメントでも、インターネットから隔離されたブラウザや仮想マシン(VM)内で実行し、ホスト環境へのアクセスを遮断する「隔離環境(Isolation)」での運用が強く推奨されています。

また、エンタープライズ企業においては、Microsoft Foundry(旧 Azure AI Foundry)のようなガバナンス基盤を経由した導入が標準的なアプローチとなります。これにより、企業ポリシーに基づいたアクセス制御(Policy Enforcement)や、トークン使用量・エラーのモニタリングが可能になります。

実務での使い方

実務においてAIエージェントを安全に稼働させるための核心が、「Human in the loop(HITL)」の実装です。これは、AIの自律的なワークフローの中に、意図的に「人間の承認(Approve/Reject)」のステップを組み込む設計思想です。

具体的には、外部へのメール送信、データベースの更新、決済の実行といった「影響の大きい操作(High-impact actions)」の直前で、AIの処理を一時停止(Checkpointing)させます。

現場感としては、すべての操作に承認を求めると人間の確認工数が膨れ上がり、AIを導入した意味が失われるという運用負荷のジレンマに陥りがちです。実務的には、リスクの大きさに応じて介入ポイントを絞り込み、ダッシュボード上でAIの「計画(Plan)」を人間がサッと確認して許可を出す、という非同期の承認フローを構築することが現実的な落とし所だと考えます。

よくある失敗と対処

AIエージェントの運用で頻発する失敗の一つが、カレンダーやスケジューリングデータとの連携における暴走です。

たとえば、AIエージェントに「来週の空き時間でクライアントとの会議を設定して」と指示した結果、エージェントが勝手に大量のダミー予約を作成してしまったり、社外秘の会議URLを誤ったメーリングリストに送信してしまったりするケースが報告されています。

対処法:SaaS側のアクセス制御とガードレール AIエージェントが操作する対象となるSaaS(例えばJicooなどの日程調整ツール)側で、厳格なアクセス制御を敷くことが不可欠です。

- IP制限やSAML認証(SSO)を用いて、AIエージェントからのアクセス経路を限定する。

- システム連携においては、GUI操作ではなく、権限が絞られたAPIやWebhookを優先的に使用する。

比較の観点

AIエージェントを社内システムに迎え入れる際、操作される側のSaaSが「AIの挙動を追跡できるか」という観点がツール選定の新たな基準となります。人間であれば「記憶」や「メールの履歴」で操作を遡れますが、高速で自律稼働するAIの場合、問題発生時の原因究明は困難を極めます。

以下は、AIエージェントの導入を前提としたSaaS選定の比較観点です(2026年3月6日時点)。

| 比較項目 | 標準的なSaaSプラン | エンタープライズ向けSaaSプラン(推奨) |

|---|---|---|

| 監査ログ (Audit Logs) | 直近の簡易履歴のみ | いつ・誰が・何をしたかの詳細な永続記録 |

| アクセス制御 | ID/パスワードのみ | IP制限、SAML認証(SSO)対応 |

| セキュリティ基準 | 一般的なクラウド基準 | エンタープライズ水準のセキュリティ要件(ISMS等) |

| **AI操作の追跡 | 人間とAIの区別が困難 | APIキーやサービスアカウント別のログ追跡が可能 |

監査ログは、もはや単なるコンプライアンス要件ではありません。AIエージェントが予期せぬ挙動をした際の「フライトレコーダー」として、デバッグや責任分解のために必須の機能となるのではないでしょうか。

さらに効率化するには

AIガバナンスを効かせながらさらに業務を効率化するには、Microsoft Foundryのようなプラットフォームを「ガバナンスの管制塔」として活用することが有効です。

開発者や現場のユーザーが個別にプロンプトで「気をつけて操作して」と指示するだけでは、組織的な統制は保てません。プラットフォームレベルでポリシー違反の検知や、Human in the loopの承認フローを強制(Enforcement)する仕組みをノーコード/ローコードで構築することで、安全性を担保したままAIの適用範囲を広げることができます。

これは美意識の問題です。テクノロジーがどれほど進化しようとも、最終的な意思決定の責任は人間が負うべきであり、その境界線をシステムアーキテクチャとしてどう美しく設計するかが、次世代のリーダーに問われています。

まとめ

GPT-5.4のComputer Use機能は、エンタープライズの業務効率を飛躍的に高めるポテンシャルを秘めていますが、同時に「自律的な誤操作」という新たなリスクをもたらします。

次のアクションとして、まずは自社でAIエージェントがアクセスする可能性のある主要SaaS(日程調整、CRM、社内DBなど)について、エンタープライズプランにおける監査ログの取得状況**を確認してください。そして、不可逆的な操作を伴う業務プロセスには、必ず人間の承認を挟む「Human in the loop」の設計を組み込むことから始めてみてはいかがでしょうか。

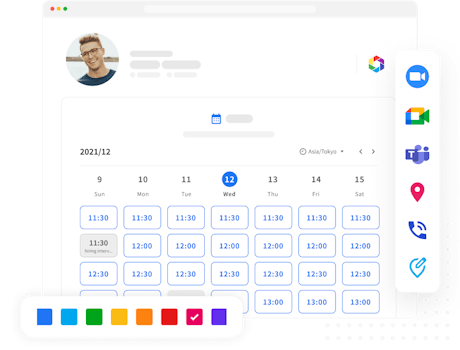

Jicoo(ジクー)について

セールスや採用などのミーティングに関する業務を効率化し生産性を高める日程調整ツール。どの日程調整ツールが良いか選択にお困りの方は、まず無料で使い始めることができサービス連携や、必要に応じたデザインや通知のカスタマイズなどの機能が十分に備わっている日程調整ツールの導入がおすすめです。

チームで使える日程調整ツール「Jicoo」とは?