データを出したくない企業のAI活用:ローカルAIエージェント(OpenClaw)とセキュアなSaaSの境界線

- 1. OpenClaw(ローカルAIエージェント)とは

- 2. 主な機能とできること

- 3. 始め方(初期設定)

- 4. 実務での使い方

- 5. よくある失敗と対処

- 6. 比較の観点

- 7. さらに効率化するには

- 8. まとめ

- 9. Jicoo(ジクー)について

対象時期: 2026年現在、生成AIの業務利用が本格化するフェーズ 対象者: 情報システム部門、DX推進担当者、セキュリティ管理者 求められる行動: ローカルAIとクラウドSaaSの「境界線」を再定義し、リスクを分離するハイブリッド運用の確立

企業におけるAI活用は、新たなパラダイムシフトを迎えています。クラウド型LLMへのデータ送信を懸念する日本企業の中で、PC内で完結する「ローカルAIエージェント」が静かなブームを呼んでいます。しかし、その裏で進行しているのは、管理者の目の届かない「シャドーAI」という新たなリスクの蔓延です。

本記事では、話題のローカルAIエージェント「OpenClaw」の事例を紐解きながら、企業が直面するセキュリティの現実と、セキュアなSaaSとの賢い使い分けについて考察します。

OpenClaw(ローカルAIエージェント)とは

OpenClaw(旧Clawdbot/Moltbot)は、ユーザーのローカル環境(PC上)で動作し、自律的にタスクを実行するオープンソースのAIエージェントです。2026年初頭にGitHubで爆発的な人気を集め、エンジニア層を中心に急速に認知を広げました。

日本企業は伝統的に「機密情報を社外のサーバーに出したくない」という強い防衛本能を持っています。そのため、インターネットから遮断された環境でも動くローカルLLMや、自己ホスト型(Self-hosted)のAI活用に対する渇望が根強く存在します。OpenClawは、まさにこの「データを出さずにAIの恩恵を受けたい」というニーズに合致したツールだと言えますね。

主な機能とできること

OpenClawが標榜するのは「実際に何かを実行するAI」です。単なるチャットボットとは異なり、以下のような自律的なアクションをローカル環境で実行します。

- ファイル操作と管理: PC内のドキュメント検索、整理、コード生成

- コマンド実行: シェルを通じたシステム操作

- 外部アプリ連携: チャットツール(Discord等)をインターフェースとした操作

これらはすべてユーザーのPC内で処理されるため、クラウドベンダーにプロンプトや社内データを送信せずに済むという大きなメリットがあります。実務的には、自分専用の「優秀なデジタル秘書」をPC内に飼っているような感覚に近いのではないでしょうか。

始め方(初期設定)

しかし、企業が組織としてOpenClawを導入・管理しようとすると、高い技術ハードルに直面します。

OpenClawはコミュニティ主導のオープンソースプロジェクトであり、特定のベンダーによる公式サポートやSLA(サービス品質保証)は存在しません。安全に運用するためには、自社でセキュアなインフラを構築し、脆弱性パッチを継続的に適用するエンジニアリングリソースが不可欠です。

現場感としては、情シス部門が公式に許可を出す前に、業務効率化を急ぐ従業員が個人の判断でインストールしてしまう「野良AI(シャドーAI)」化が最大の懸念事項だと考えます。管理されない自律型AIは、従来のシャドーITとは比較にならないレベルの権限をPC内で持ってしまうからです。

実務での使い方

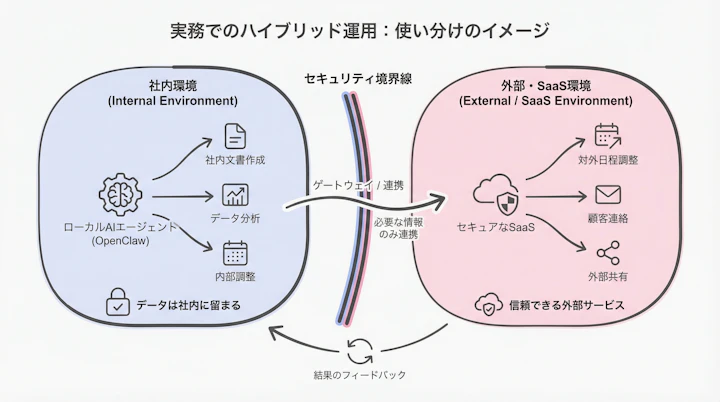

では、企業はどのようにAIエージェントと向き合うべきでしょうか。ここで重要になるのが、業務の「内」と「外」を明確に切り分けるというアプローチです。

1. 社内完結業務(内) ローカルPC内のファイル整理や、外部と通信しない閉鎖環境でのコード生成など、完全に「内側」で完結する業務には、ローカルAIエージェントのポテンシャルを活かす余地があります。

2. 対外調整業務(外) 一方で、顧客との日程調整やWeb会議URLの発行など、外部との接点を持つ業務をローカルエージェントに委ねるべきではありません。外部からのメールやメッセージをAIが読み込むことで、予期せぬ攻撃経路を開いてしまうからです。

3. ハイブリッド運用 「社内の閉じた作業はローカルで、外部との接点は信頼できるSaaSで」という境界線を引くこと。これが、現時点での最も現実的で賢い使い分けの姿です。

よくある失敗と対処

現場の従業員が「少しでも業務を楽にしたい」と願う気持ちには、深く共感すべきものがあります。日々の煩雑なタスクに追われる中で、自律的に動くAIツールに飛びつきたくなるのは人間として自然な欲求です。

しかし、客観的なリスクとして、Ciscoなどのセキュリティ研究チームは、OpenClawのようなツールにおける「データ流出(Data Exfiltration)」の脆弱性を警告しています。外部から送られた悪意あるメッセージをAIが読み込むだけで、ローカルの機密ファイルやAPIキーが外部に送信されてしまう「間接的プロンプトインジェクション」のリスクが指摘されているのです。

「ローカルだから安全」というのは、完全なオフライン環境でのみ成立する幻想です。外部と通信する機能を持たせた瞬間、ローカル環境は「外部からの攻撃に対して丸腰になる」という逆のリスクを抱えることになります。この事実を組織全体で冷静に認識し、代替となる安全な環境(許可されたSaaSなど)を情シスが提供することが、シャドーAIを防ぐ最大の対処法となります。

比較の観点

外部との接点となる業務(例:日程調整)において、自己ホスト型のローカルAIと、エンタープライズ水準のSaaS(例:Jicoo)では、セキュリティの担保方法が根本的に異なります。

| 比較項目 | ローカルAIエージェント(OpenClaw等) | セキュアなSaaS(Jicoo エンタープライズ機能等) |

|---|---|---|

| 管理責任 | 自社(自己責任) | ベンダー(SLAに基づく) |

| アクセス制御 | 端末ごとの個別設定が必要 | IPアドレス制限、SAML/SSOによる一元管理 |

| 監査・追跡 | ローカルログの収集基盤が別途必要 | クラウド上での監査ログ(Activity Logs)提供 |

| 第三者認証 | なし(オープンソース) | ISO27001などの国際的なセキュリティ認証(※取得状況は公式サイト等で要確認) |

| 外部攻撃リスク | PC内の全データが脅威に晒される可能性 | ベンダーの防壁内で処理され、社内PCとは隔離 |

※比較基準日:2026年3月6日時点

SaaSを利用することは、単にツールを借りるだけでなく、「セキュリティリスクと運用保守の責任をベンダーにオフロードする」という投資行動に他なりません。

さらに効率化するには

AI時代における業務効率化は、単なるツールの導入競争ではありません。長期的な組織戦略として、「自社で守るべきコアなデータは何か?」「どの業務のセキュリティに自社のリソースを割くべきか?」という問いを立てるべきです。

日程調整のような、重要ではあるが自社のコアコンピタンスではない業務において、自前でセキュリティの防壁を築き、無限の運用コストと責任を負うのは合理的とは言えません。

外部との接点は、IP制限やSSO連携、監査ログといったエンタープライズ機能で守られたSaaSの堅牢な防壁の中に移譲する。そして、浮いた社内のエンジニアリングリソースを、真に競争力を生むコア業務のAI化に集中させる。これこそが、全体最適を見据えた効率化の姿ではないでしょうか。

まとめ

データを出したくないという防衛本能からローカルAIに惹かれる心理は理解できますが、未管理の自律型エージェントは組織に致命的な脆弱性をもたらす可能性があります。

リーダー層は今、テクノロジーの利便性とセキュリティの境界線をどこに引くかという、組織の「美意識の問題」に向き合っています。何でも自前で抱え込むのではなく、信頼できる外部SaaSに「外の業務」を委ねる決断が求められています。

まずは自社内で稼働している「野良AI」の実態を把握し、従業員が安全に外部との調整業務を行えるよう、JicooのようなセキュアなSaaS環境の標準化(ガイドライン策定とライセンス配布)を進めることから始めてみてはいかがでしょうか。それが、人間性を回復し、本来の創造的な業務に集中するための第一歩となるはずです。

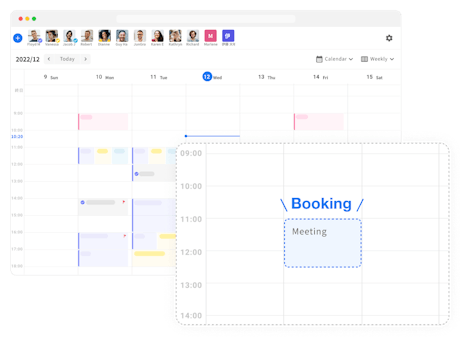

Jicoo(ジクー)について

セールスや採用などのミーティングに関する業務を効率化し生産性を高める日程調整ツール。どの日程調整ツールが良いか選択にお困りの方は、まず無料で使い始めることができサービス連携や、必要に応じたデザインや通知のカスタマイズなどの機能が十分に備わっている日程調整ツールの導入がおすすめです。

チームで使える日程調整ツール「Jicoo」とは?