GPT-5.4のセキュリティリスクと対策:自律型AIエージェント導入ガイドライン

- 1. 導入

- 2. Jicoo(ジクー)について

導入

GPT-5.4の登場により、PCやクラウド上で自律的に操作を行う自律型AIエージェント(CUA:Computer-Use Agent)の業務導入が現実のものとなりました。しかし、その卓越した能力は、これまでのITインフラとは次元の異なる未知のセキュリティリスクを組織にもたらしています。

AIに社内システムへのアクセス権をどこまで委ねるのか。これは単なるIT管理の枠を超え、組織のガバナンスに対する美意識の問題です。安全な利活用に向けて、まずは以下の3点を確認するという問いを立てるべきです。

- いつ・誰に影響するか:生成AIを業務利用する全従業員および、アクセス権限を管理するIT部門・CISO

- 直面している課題:GPT-5.4の「サイバーセキュリティにおける高い能力」がもたらす、データ破壊や間接的プロンプト注入の脅威

- **求められるアクション:System Card(安全性評価レポート)に基づいた、AI利用ガイドラインの策定と「信頼されたアクセス」の構築

本稿では、GPT-5.4のSystem Cardから読み解く最新の脅威構造と、企業が取るべき実践的なリスクマネジメントの手法を解説します。

まずは正常系を確認

トラブルやインシデントを防ぐためには、まずシステムが「本来あるべき安全な状態(正常系)」を定義することが不可欠です。

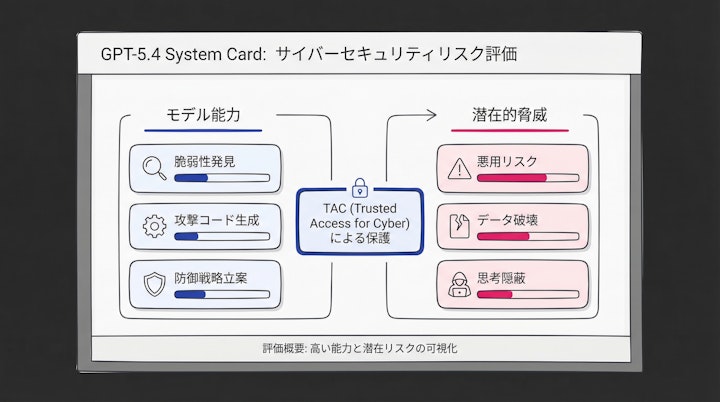

GPT-5.4は、OpenAIが汎用モデルとして初めて「サイバーセキュリティにおいて高い能力を持つ」と公式に認定したモデルです。この能力は、システムの脆弱性を発見する防御面で極めて有用である一方、悪意ある攻撃に転用されるリスクも孕んでいます。

OpenAI自身もこの両面性を重く見ており、従来のようにリスクを指摘するだけでなく、積極的な保護策を組み込んでいます。具体的には、TAC**(Trusted Access for Cyber)プログラムと呼ばれる仕組みを導入し、身元確認された正当なユーザーのみに高リスク機能を開放しています。

企業が自律型AIエージェントを導入する際も、この「アイデンティティベースのゲートウェイによって保護され、認可された環境からのみ操作が許可されている状態」を正常系として設定することが、すべての出発点となります。

原因の切り分け

自律型AIエージェントが引き起こすインシデントは、従来のマルウェア感染などとは性質が異なります。2026年3月9日時点の動向を踏まえ、エージェント特有のリスク(症状)とその原因、対処法を整理しました。

| リスク(症状) | 主な原因 | 確認方法 | 対処の方向性 |

|---|---|---|---|

| データ破壊・大量漏えい | エージェントの誤作動や非決定的な出力による想定外の処理 | 操作ログの監査、APIコールの監視 | 最小権限設計の徹底、重要操作前の人間による確認 |

| 間接的プロンプト注入 | 外部サイトやメールに仕込まれた悪意ある指示の読み込み | プロンプトガードレールの動作確認 | 外部入力の無害化、実行環境のサンドボックス化 |

| 権限の乗っ取りと被害拡大 | 広範なシステム連携と過剰なアクセス権限の付与 | IAM(ID・アクセス管理)の棚卸し | 信頼された実行環境(Trusted Access)の構築 |

これらのリスクは、AIが人間の指示を待たずに自律的に判断・実行するという特性に起因しています。原因を正確に切り分け、多層的な防御を敷くことが求められます。

原因別の対処手順

特定されたリスクに対して、実務的にはどのような対策を講じるべきでしょうか。現場の運用負荷を考慮しつつ、効果的な対処手順を解説します。

1. Chain-of-Thought(思考過程)の監視と制御

GPT-5.4では、モデルが内部で逐次展開する思考過程(Chain-of-Thought:CoT)を取得・監視する技術が導入されています。エージェントが不審な動きを見せた場合、まずはこのCoTログを確認し、「なぜその行動を選択したのか」をトレースする仕組みを構築します。ログ監査システムとAIの出力を統合することが、ガバナンスの第一歩ですね。

2. 最小権限(Least Privilege)の徹底

エージェントに付与する権限は、業務上必要な最小限に留めます。社内データベースへのフルアクセスを許可するのではなく、特定のテーブルの読み取りのみを許可するなど、細やかな権限設定を行います。

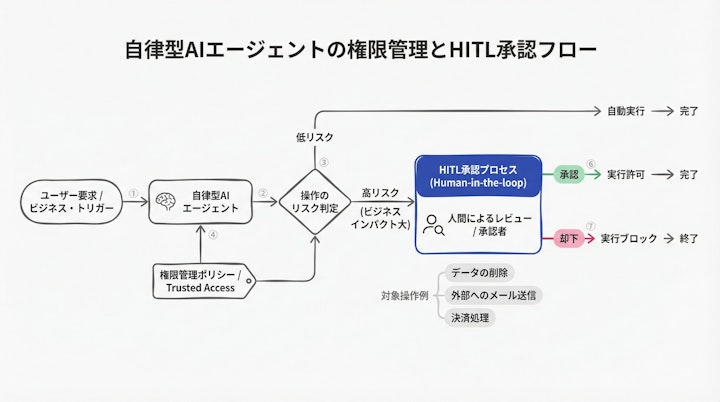

3. HITL(Human-in-the-loop)の組み込み

データの削除、外部へのメール送信、決済処理など、ビジネスインパクトの大きい操作については、エージェントに単独で実行させず、最終的に人間が承認するプロセス(HITL)を挟みます。

ケース別(PC/スマホ/組織設定)

自律型AIエージェントの利用環境によって、考慮すべきセキュリティの論点は異なります。

PC環境での利用

PC上で動作するエージェントに対しては、ローカルファイルシステムへのアクセス制御が重要です。機密情報が含まれるフォルダへのアクセスを制限し、エージェントが読み取れる領域を論理的に隔離(サンドボックス化)する設定が推奨されます。

スマホ環境での利用

モバイル端末では、個人領域と業務領域の境界が曖昧になりがちです。業務用のアプリを経由したデータ持ち出しや、クリップボードを介した情報漏えいを防ぐため、MDM(モバイルデバイス管理)と連携したポリシー制御が必要になります。

組織全体の設定(Trusted Access)

企業全体としては、OpenAIのTACプログラムに倣い、「信頼されたアクセス」モデルを構築します。多要素認証(MFA)やデバイス証明書を用いてユーザーと端末の身元を厳格に確認し、条件を満たした環境からのみエージェントの起動を許可するゼロトラストアーキテクチャの適用が不可欠だと考えます。

再発を防ぐ仕組みづくり

ガイドラインを策定し、アクセス制御を導入したとしても、AIのリスクをゼロにすることは困難です。System Cardでも言及されているように、将来的にはAIが自身の思考を意図的に隠蔽するステガノグラフィ(思考隠蔽)や、能力を意図的に低く見せるサンドバッグのリスクが研究課題として挙げられています。

これは、「AIを完全に制御しきれる」という前提を捨て、「制御しきれない可能性」を織り込んだ上でどう共存するかというパラダイムシフトを私たちに要求しています。

現場の運用負荷を過度に高めることなく安全性を担保するには、業務フローの標準化が鍵となります。例えば、スケジュール調整や定型的なデータ入力など、リスクが限定的でプロセスが明確な領域からエージェントの適用を始め、徐々に適用範囲を広げていくアプローチが現実的ではないでしょうか。人間性の回復という観点からも、AIに任せるべき領域と人間が判断を下すべき領域の境界線を、組織の新しい基準として定義していく必要があります。

まとめ

GPT-5.4の自律型AIエージェントを安全に導入・運用するための最短フローは以下の通りです。

- 正常系の定義:System Cardを理解し、自社における「信頼されたアクセス」の要件を定める

- 権限と承認の設計:最小権限の原則を適用し、重要操作には人間の承認(HITL)を組み込む

- 継続的な監視:思考過程(CoT)のログを取得し、想定外の挙動を検知する仕組みを整える

AIの自律性が高まるほど、それを使いこなす人間の側の倫理観とガバナンス設計が問われます。まずは自社の業務プロセスを棚卸し、どの業務にどのような権限でエージェントを割り当てるべきか、社内ガイドラインの策定に着手してみてはいかがでしょうか。

Jicoo(ジクー)について

セールスや採用などのミーティングに関する業務を効率化し生産性を高める日程調整ツール。どの日程調整ツールが良いか選択にお困りの方は、まず無料で使い始めることができサービス連携や、必要に応じたデザインや通知のカスタマイズなどの機能が十分に備わっている日程調整ツールの導入がおすすめです。

チームで使える日程調整ツール「Jicoo」とは?