AI面接官導入の課題と対策:公平性・規制への対応策【5選】

- 1. 導入

- 2. 先に結論

- 3. 選定軸

- 4. おすすめ一覧

- 5. 各ツールの特徴

- 6. 失敗しない選び方

- 7. 日程調整ツールを選ぶなら

- 8. まとめ

- 9. Jicoo(ジクー)について

採用プロセスの効率化を目指す人事責任者や経営層に向けて、本記事の要点を3つにまとめます。

- いつ(When):EUのAI規則成立や各国の法規制強化が進む現在、AI採用ツールの導入には慎重なリスク評価が求められています。

- 誰が(Who):面接工数の削減と評価の標準化を目指す人事担当者および経営陣は、効率化の裏に潜むリスクを直視する必要があります。

- どうすべきか(Action):導入前にアルゴリズムのバイアスやアクセシビリティの課題を把握し、人間の関与(ヒューマン・イン・ザ・ループ)を前提とした運用体制を構築すべきです。

導入

日本国内でも、2025年時点で主要企業の約30%が採用プロセスにAIを「導入済みまたは導入計画あり」と回答するなど、AI面接官の普及が本格化しています。移動負担の削減や評価基準の統一といったメリットは大きく、hr領域におけるデジタルトランスフォーメーションの象徴とも言える動きですね。

しかし、効率化の恩恵の裏には、未知のバイアスや倫理的リスクが潜んでいます。AIに人間の評価を委ねることは、単なるツールの導入にとどまらず、組織の採用哲学そのものが問われるパラダイムシフトを引き起こしています。本記事では、2026年3月10日時点の最新の法規制動向や専門家の提言を踏まえ、AI面接官を導入する際に直面する課題と、その実践的な対策を紐解いていきます。

先に結論

結論から申し上げると、AI面接官の導入において企業が事前に対策すべき課題は、大きく以下の5つに集約されます。

- アルゴリズムのバイアスによる不当な差別の助長

- 非ネイティブ話者や障がい者に対する配慮不足

- 機械的な対応による候補者エクスペリエンスの悪化

- センシティブなデータプライバシーとセキュリティの懸念

- 各国で急速に進む法規制へのコンプライアンス対応

これらの課題に対する最も有効なアプローチは、「システムの透明性を確保すること」と「最終的な判断を人間に委ねる代替手段を用意すること」だと考えます。

選定軸

AI面接ツールを安全に選定し、運用に乗せるためには、単なる機能比較ではなく、リスクマネジメントの観点から以下の5つの評価軸を持つべきです。

- 公平性の監査機能:多様な属性のデータセットでモデルが検証・調整されているか。

- アクセシビリティの担保:音声認識の精度差を補正する仕組みや、合理的配慮に基づく代替手段が提供できるか。

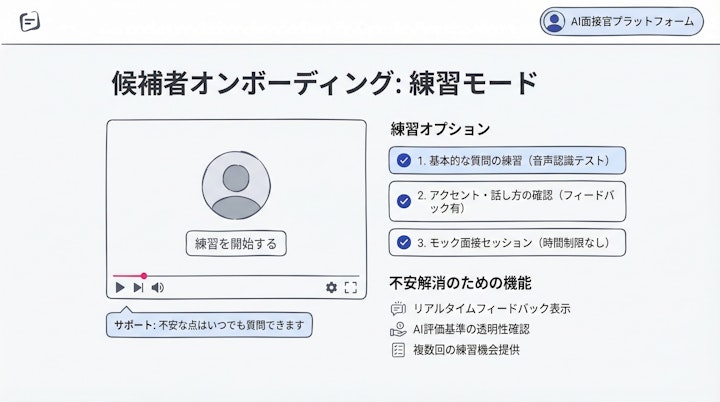

- オンボーディングの充実度:候補者が本番前にシステムに慣れるための練習テスト機能があるか。

- データ保護の透明性:録画・音声データの利用目的が明示され、候補者からの削除要求に迅速に対応できるか。

- 規制への準拠:国内外の最新のAIガイドラインやプライバシー法制に適応するアップデート体制があるか。

おすすめ一覧

AI面接官の導入にあたっては、各国の法規制やガイドラインが求める要件をクリアすることが大前提となります。以下は、企業が対応を迫られる主要な規制動向と求められるアクションの整理です(2026年3月10日時点)。

| 規制・ガイドライン名 | 対象地域 | 企業に求められる主な対応要件 |

|---|---|---|

| EU AI規則 | 欧州連合 | 採用AIを「高リスク」に指定。透明性の確保、リスク評価の義務化、人間の監視体制の構築。 |

| AIビデオ面接法 | 米国(イリノイ州等) | 候補者への事前通知と同意取得、データ共有の制限、候補者の希望に応じた動画データの削除。 |

| アルゴリズム雇用ツール法 | 米国(ニューヨーク市) | AIツールのバイアス監査の義務化、監査結果の公開、候補者への代替評価プロセスの提示。 |

| AI事業者ガイドライン | 日本 | リスク管理体制の構築、ステークホルダーへの説明責任、人権への配慮とプライバシー保護。 |

これらの要件は、グローバル企業のみならず、国内でrecruitment活動を行うすべての企業にとって、今後のスタンダードとなる基準だと言えます。

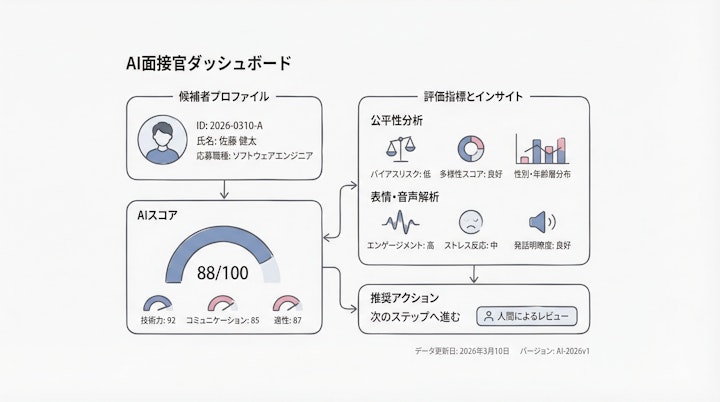

各ツールの特徴

AI面接官システムが持つ機能的な特徴は、そのまま企業が向き合うべき課題と表裏一体です。ここでは、システムの特徴に内在する5つの課題と、その具体的な対策を深掘りします。

課題1:AIアルゴリズムのバイアス

AI面接官は過去の採用データを学習して評価モデルを構築します。しかし、過去のデータに性別、人種、年齢などの偏見が含まれている場合、AIはそれを「正解」として学習し、差別を再生産・助長するリスクがあります。実際、米国ではAIシステムが特定の属性に不利に働いたとして訴訟に発展した事例も報告されています。 対策:特定のベンダーに依存せず、多様な候補者データでモデルの精度検証を定期的に行うこと。また、職務遂行能力と直接関係のない評価項目(表情の微細な変化など)をスコア化の対象から除外することが重要です。

課題2:非ネイティブ話者・障がい者への配慮不足

音声認識AIは、アクセントや話し方の違いによって精度が大きく変動します。ある分析では、英語ネイティブの認識エラー率が19%であるのに対し、非ネイティブでは35%以上に達すると指摘されています。また、自閉症や言語障がいを持つ候補者に対して、画一的なAI面接は著しく不利に働く恐れがあります。 対策:システムによる評価を絶対視せず、必要に応じて人間による面接への切り替え(代替手段の提供)を制度化すること。これは法的な合理的配慮の観点からも不可欠ですね。

課題3:候補者エクスペリエンスへの影響

一方通行の録画面接に対して、「機械的で不気味だ」とストレスを感じる候補者は少なくありません。ある人材専門家は、AI面接の導入によって候補者の70%が離脱したケースがあると指摘しています。効率化を求めて優秀なタレントを逃しては本末転倒です。 対策:事前にAI面接の目的や評価の仕組みを丁寧に説明し、本番前に練習問題で操作に慣れてもらう機会を提供すること。候補者の不安を取り除くオンボーディング体験の設計が求められます。

課題4:データプライバシーとセキュリティ

AI面接では、顔の映像や声紋といった極めてセンシティブな生体データを扱います。これらのデータがどのように保管され、誰に共有されるのかが不透明であれば、企業への信頼は失墜します。 対策:個人情報保護法に基づき、データの利用目的を限定し、明確な同意を取得すること。また、不採用となった候補者のデータは速やかに破棄する運用ルールを徹底する必要があります。

課題5:法規制の動向とコンプライアンス対応

前述の表で示した通り、AIを用いた採用活動に対する規制は世界中で強化されています。日本国内でも、総務省・経産省が2024年に公表したガイドラインにおいて、AI利用時の説明責任や人権配慮が強く求められています。 対策:法規制を先取りする形で、候補者への事前説明プロセスを標準化すること。コンプライアンスは「守り」ではなく、公正な採用を行っているという「企業ブランドの証明」として機能します。

失敗しない選び方

現場感としては、数百、数千という応募者を限られたリソースでさばかなければならない採用担当者の疲弊は深く理解できます。面接工数を少しでも削減したいというプレッシャーは、経営陣が想像する以上に重いものです。

しかし、目先の業務負荷を下げるために、ブラックボックス化したAIに「合否の決定権」を委ねることは、企業にとって致命的なリスクとなります。客観的な事実として、現在のAIは文脈の理解や人間特有のポテンシャルを見抜く点において完全ではありません。

失敗しないための最大のポイントは、AIを「決定者」ではなく、あくまで面接官をサポートする「補助者」として位置づけることです。初期スクリーニングにAIを活用したとしても、最終的な採用判断には必ず人間が関与するプロセス(ヒューマン・イン・ザ・ループ)を設計することが、実務的かつ最も安全なアプローチではないでしょうか。

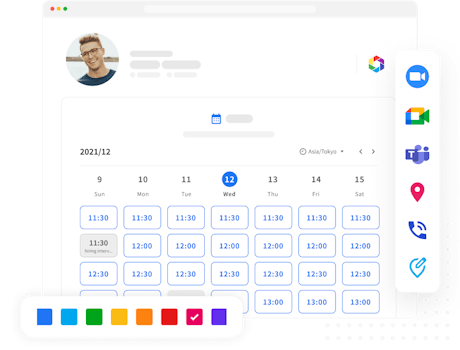

日程調整ツールを選ぶなら

もし、AI面接官の導入に伴う倫理的リスクや法規制への対応ハードルが高いと感じる場合、まずは「人間による面接」のオペレーションを極限まで効率化するアプローチに立ち返ることも有効です。

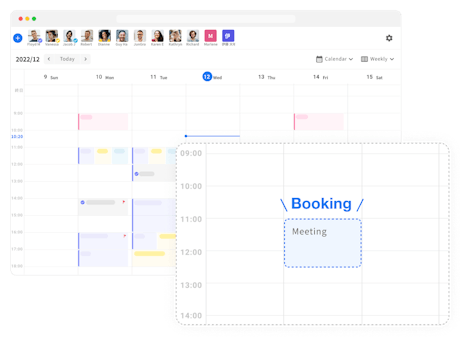

面接候補日時のすり合わせ、カレンダーの確保、Web会議URLの発行といった作業は、AIによる評価リスクを一切伴わずに自動化できる領域です。例えば、productivityを向上させる日程調整ツールを導入することで、候補者との往復連絡をなくし、採用担当者の事務工数を劇的に削減できます。

候補者体験を損なうことなく、人間が「対話」に集中できる環境を整えること。それが、採用活動の質を高めるための確実な第一歩だと言えます。

まとめ

AIに「誰を採用すべきか」という判断の一部を委ねることは、単なる業務効率化の枠を超え、「我々の組織にとって優秀さとは何か」「人間性とは何か」という本質的な問いを外部化することに他なりません。

効率性のみを追求した採用プロセスは、やがて組織の同質化を招き、イノベーションの芽を摘むことになります。候補者の多様性を尊重し、人間性の回復をどうシステムとオペレーションの中に組み込んでいくか。これはもはやコンプライアンスの問題ではなく、経営陣の美意識の問題です。

AI時代において、自社の採用プロセスが社会や候補者に対してどのようなメッセージを発しているのか。リーダー層は今こそ、その問いを立てるべきです。新しい技術を使いこなすための真の基準は、常に「人間への敬意」の中にあると考えます。

Jicoo(ジクー)について

セールスや採用などのミーティングに関する業務を効率化し生産性を高める日程調整ツール。どの日程調整ツールが良いか選択にお困りの方は、まず無料で使い始めることができサービス連携や、必要に応じたデザインや通知のカスタマイズなどの機能が十分に備わっている日程調整ツールの導入がおすすめです。

チームで使える日程調整ツール「Jicoo」とは?